联合国建议多方面规范AI人工智能 私隐/性别平等/环境保护|STEM教室

2024-10-23 14:00

在早前的STEM专题,我们探讨过「元宇宙」这个近期热门话题。要创建如此庞大的虚拟世界,须要电脑的帮助,例如利用人工智能建立一些基本架构和内容。在可见的未来,人工智能将会高速发展,其分析甚至思考能力亦必会大大提升。然而,就如很多先进技术一样,人工智能可否被好好使用,取决于人们手上;因此,我们须要为人工智能的应用制定规则。就让我们看看现时一些潜在问题,以及2021年联合国教科文组织 (UNESCO)推出的协议——《人工智能伦理问题建议书》,如何针对这些隐患。

认知:现时的人工智能……

无论从以往的STEM专题所提及,还是日常生活的应用,我们都看到人工智能(ArtificiaI Intelligence, AI)愈来愈普及,医疗、金融、物流、交通、教育,甚至创意产业,都有AI的足迹。除了不少先进科技都与人工智能挂鈎,AI还可以帮助政府或私人企业作出决策,甚至能用以应付气候变化。现时,部分中小学生已经开始学习编程来进行人工智能应用,可见将来,AI或会如手机一样,成为人们的「必需品」。然而,一旦多人使用,就难免会出现「使用不当」的情况。

私隐安全问题浮现

如同电话骗案、网络欺凌等罪行,随着通讯科技的普及而出现,有关人工智能的私隐、安全等问题亦逐渐浮现。根据联合国教科文组织的声明,这些问题包括大规模监视、性别或种族歧视等;另外,在法律执行上亦不时出现不当使用情况,而现时正正没有一套普遍适用的准则来针对解决上述问题。

协议保证良性发展

有见及此,在2021年十一月,联合国教科文组织的所有193个成员国历史性通过了《人工智能伦理问题建议书》,旨在保证AI的良性健全发展,以及对有关的共同价值及原则作定义。这份《建议书》认同AI的优点及贡献,同时强调减低相关风险的方法。UNESCO总干事Audrey Azoulay指出,现今世界须要针对AI制定一套规则来促进人类福祉,而《建议书》所提出的架构,赋予每个成员国责任在国内实施推行,并要定期向UNESCO汇报进展。

《建议书》提供了一系列如数据管治(data governance)、教育、医疗保健及经济等指引,确保成员国在进行数位化转型的同时,亦做到保障人权以及达成可持续发展目标。

愈来愈多产品及技术都牵涉人工智能,因此更显订立准则的必要;协议针对透明度、问责性及私隐性提供详尽建议,让各成员国跟随:

接下来,我们就集中看看,人工智能与三个要项:私隐、性别平等,以及环境保护的关系,以及所需的准则为何。

AI与私隐:改善数据管治 保障市民私隐

要认识人工智能与私隐之间的关系,我们首先要知道一个Al系统的「生命周期」。简单来说,一个周期可以分为四个阶段:

- 设计、数据与模型:根据须要解决的问题或情境,设计一序列行动, 包括资料收集、处理,并计算出一个模型/演算法。

- 核实模型:经收集所得的资讯而成的模型有待验证,在这阶段中,人们会利用这个模型作出预测,并与真实情况作对比。

- 部署:假如模型能够做到准确预测,或是成功进行任务(如辨认物件),就能作更多应用范畴。

- 执行及监察:在执行一些较大规模的应用时,我们仍要继续监察其成效,以及有没有出现其他问题。

收集大量数据进行分析

任何人或机构利用Al(即是参与Al系统的生命周期)时,都要先进行收集数据的步骤,特别是一些企业在推出策略性计画前,都要先从潜在客户里收集资讯并作出分析。以前的市场调查可能是以电话、实体问卷调查等 方式进行,而现时有了人工智能,则可以通过更多渠道收集资料。最常见的例子莫过于社交媒体,如软件通过人工智能收集我们观看影片或浏览网页的习惯,分析出用户的喜好,进而推荐更多相关内容。

收集过程易侵私隐

然而,当数据资料愈来愈容易收集,亦即更容易侵犯到人们的私隐。例如自动驾驶技术,须「训练」车辆分辨道路上的东西,如车、树、人等, 首先就要让安装在车上的相机拍摄路面状况,再学习辨认拍摄到的物件,这样,便会把一些人的行踪都记录下来,因此有侵犯私隐的嫌疑。

延伸阅读:LinkedIn 10.11起暂停使用香港用户资料训练AI 私隐专员公署表欢迎

监视活动须符人权

有见及此,《建议书》所提出的十大原则,其中一项就是关于私隐与人权。除了提出运用人工智能前必先要作出私隐影响评估,还强调禁止大规模监视。

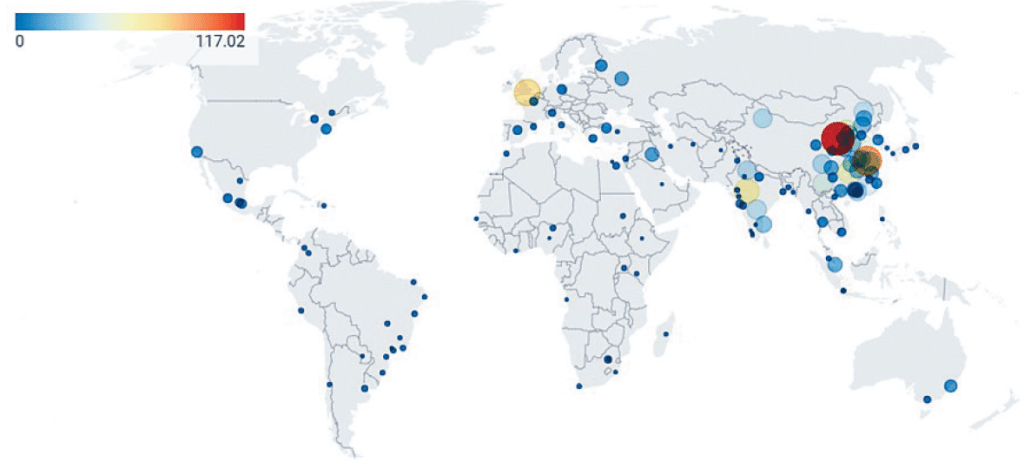

中国近年推出的社会信用体系制度,目的是要规范民众在公共场合的行 为。这体系运用到「天网」系统,在全国各地有数以亿个公共监视网络摄影机,配合脸部识别技术及大数据分析,能够监察市民的一举一动,并作社会评分。

推出了最新协议,虽然未必足以令一些国家全面解除使用公共监视网络摄影机,但可望相关监视活动只会用于符合人权的用途。

AI与性别平等:无形扩阔 性别不平等

2019年,美国一对夫妇申请信用卡时,发现丈夫的信用额度比太太高出20倍,这是客户服务职员无法解释到的情况。现时设定信用额度,由于要检核一系列个人资讯,不少银行机构已把这繁复工序交由电脑进行,并由人工智能学习审批。

偏差案例影响评估

然而,人们发现,即使交由电脑处理,性别不平等对待这种看似是人为问题,却仍然存在。由于初期人工智能并不成熟,利用婚姻状况及性别来决定信用额,导致出现性别偏差。现时,即使在应用中尝试减少社会中存在的不公因素,但由于人工智能会利用以前的资料作未来的预测,亦即是会参考以往曾出现偏差的案例,因此亦未能做到男女完全公平待遇。

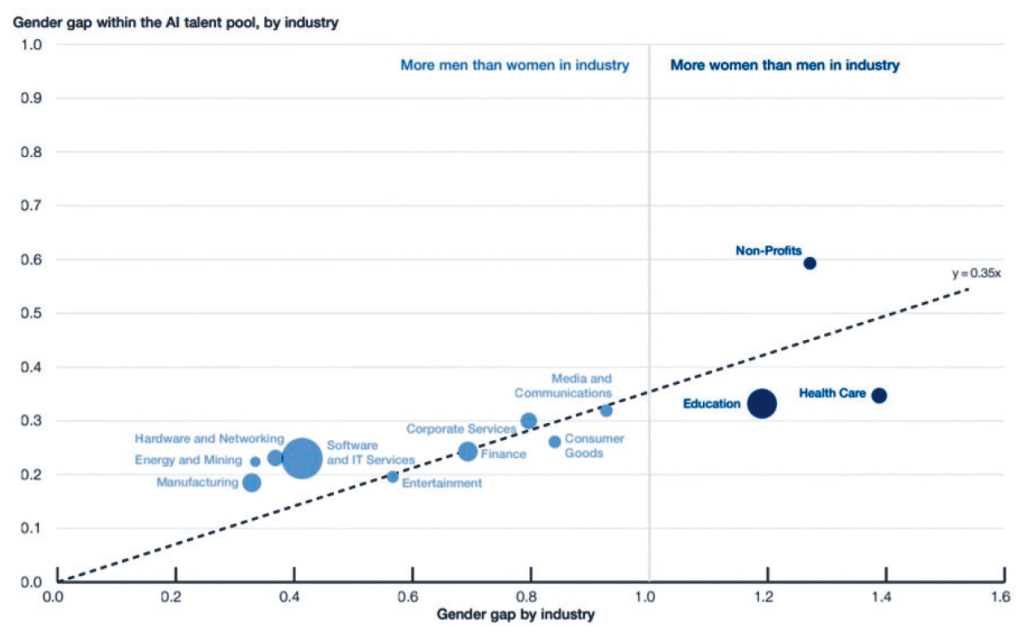

男性主导业界发展

如何解决男女不平等(甚至推而广之到种族不平等)的问题?

- 首先,在设计人工智能模型时便要加入性别作分析因素,可以的话,应把资料分为男性和女性各自分析。

- 其次,正如《建议书》所述,政府应投入资金推动性别相关计画,从而令女性不会在由AI支援的电子经济中受到忽略。

- 再者,政府或社会应该给予女性在教育及就业上更多接触STEM或Information and Communication Technology(ICT)的机会。

根据「世界经济论坛2018年」有关性别差距的报告,在所有从事AI或资料科学的专业人士当中,只有两成二为女性。当一个行业男女比例不均时,男性在发展AI技术时,容易有意或无意间导入男性普遍价值观或性别定型,因此长远而言,我们还是须要鼓励更多女性加入AI行业,方能改善问题。

AI与环境保护:发展科技 须顾及环境

2021年在苏格兰格拉斯哥举行的第26届联合国气候变迁大会,其中一个焦点是要在 2050年前达致全球净零排放。要达成这个巨大目标,科技配合自然不能少,利用人工智能亦是一大趋势,例如以AI及深度学习准确量度、模拟、追踪碳排放,有助改善企业生产方式来减低排放量。

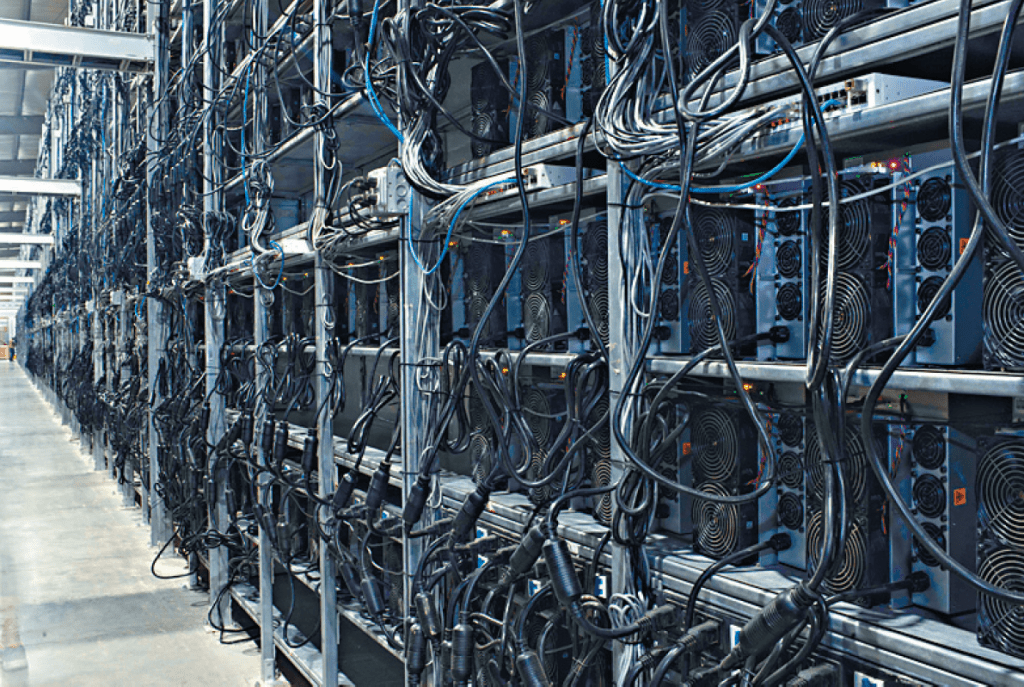

「运算」「挖矿」消耗能源

然而,虽然AI能够用以研发一些应对气候变化的技术,但发展人工智能其实亦会制造一定排放。由于AI需要大量数据学习,因此人们要建造大型资料储存库,而电脑高速运算时亦要消耗一定能源,加上近年虚拟货币兴起,人们利用人工智能「挖掘」货币也消耗大量能源。

因此,《建议书》亦提醒各成员国在启动Al系统「生命周期」前,先评估对环境将会造成的直接及间接影响,包括碳足迹、能源及原材料消耗等等,并呼吁要遵守环境条例及政策,才能真正做到以Al保护环境。

延伸阅读:Google购核能为AI数据中心供电 全球业界首例

文:刘心 图:星岛图片库、UN News、comparitech、World Economic Forum、网上图片

延伸阅读:

施政报告2024︱李家超︰政府将设立100亿元「创科产业引导基金」 系统性建设创科生态圈

最新回应